- 버너스리는 미래의 웹은 시맨틱 웹Semantic Web이 될 것이라고 2001년 전망한 바 있다. 시맨틱은 '의미론적인'이라는 뜻이다. 무수히 많은 정보의 홍수 속에서 불필요한 정보를 걷어내고 사 용자에게 꼭 맞는 정보를 제시해야 한다는 것이었다.

모두가 손쉽게 이용하는 범용성을 갖추면서도 나에게 꼭 맞 는 정보를 골라 볼 수 있다는 점에서 개인화된 특징을 모두 갖 고 있는 웹은 기술적으로는 구현하기 어려워 보였다. 하지만 챗GPT가 등장하면서 많은 이가 웹의 변화를 목격하고 있다. 마이크로소프트가 챗GPT를 업데이트해 자사의 검색엔진인 빙Bing에 탑재했으며, 구글 역시 새로운 인공지능 검색엔진의 도입을 서두르고 있다. 생성형 인공지능의 등장으로 모든 이의 예상을 깨고 웹3.0의 서막이 서서히 올라가고 있는 것이다.

- "스스로 학습할 수 있는 인공신경망은 훗날 인간의 두뇌처럼 사고하고, 다른 행성에 보내져 우주탐사 활동에도 쓰일 것이다.” (프랭크 로젠블랫)

- 20세기에 접어들자 수학자들은 모든 논리를 수학으로 증명 할 수 있으리라 믿었다. 영국의 철학자이자 수학자인 버트런드 러셀 Bertrand Russell 과 앨프리드 화이트헤드Alfred Whitehead는 《수학 원리 Principia Mathematica》를 통해 언어 중심의 논리학에 종지부를 찍었다. 이들은 모든 명제는 수학적 형식으로 증명할 수 있다 고 믿었다. 이 책은 훗날 등장할 수많은 학자에게 큰 영향을 주 었으며, 이를 반박하고 재반박하는 과정을 통해 컴퓨터과학은 크게 발전한다.

- 수학이 논리학을 대신할 것이라는 생각에 도전한 이는 독일 의 수학자 쿠르트 괴델 Kurt Gödel이었다. 그는 1931년 《수학 원리》와 관련 체계들의 형식적으로 불가능한 명제들에 관하여> 라는 논문을 발표하면서 학계의 시선을 사로잡았다. 러셀과 화이트헤드는 수학적으로 풀 수 없는 논리란 존재하지 않는다고 선언했지만, 괴델은 아무리 완벽한 논리 체계를 만들더라도 참 인지 거짓인지 판단할 수 없는 명제는 반드시 존재한다는 사실 을 수학적으로 입증했다.

- 폰노이만은 최초의 프로그램 내장 방식 컴퓨터인 에드박 EDVAC 개발에 참여해 오늘날 컴퓨터와 같은 입력, 제어, 산술 및 논리, 기억, 출력 장치라는 방식을 고안한다. 새로운 프로그램 을 구동하기 위해 하드웨어를 통째로 바꾸는 번거로움이 사라 진 것이다. 핵심은 중앙처리장치 CPU 옆에 기억장치를 붙인 것 인데, 필요한 자료를 기억장치에 저장한 뒤 사람이 지시하는 명령에 따라 해당 작업을 차례로 불러내는 방식이었다.

폰노이만 구조는 현대적 컴퓨터 구조라는 점에서 큰 의의가 있지만 중요한 과제를 남겼다. 폰노이만이 이러한 방식을 고안할 때 참고한 것은 인간의 사고 능력이었다. 사람은 평상시 모 든 기억을 항상 떠올리고 살진 않지만 특정 기억이 필요한 경 우 머리를 짜내 기억을 되살린다. 메모리에 보관된 데이터를 필요시 CPU에 불러내 사용한다는 아이디어는 사람을 모사한 장치였다.

하지만 폰노이만 구조는 기계적으로 하나씩 순차적으로 불 러내야 한다는 점에서 막대한 데이터를 처리해야 하는 인공지능 연산에서는 적합하지 않았다. 연산할 숫자의 자릿수가 증가할 때마다 계산에 필요한 시간은 기하급수로 증가한다. 10의 13 자릿수를 계산할 때 10초가 걸린다면 10의 20자릿수는 그 1000만 배인 1억 초(약 3년)가 소요된다.

생각이 틀을 규정하기도 하지만, 틀이 생각을 규정하기도 한 다. 컴퓨터과학계에서 상징과 기호 효율을 중시하는 기호주의 학자들이 인간의 두뇌를 닮은 연결주의 인공지능이 실패할 수 밖에 없다고 믿었던 이유도 폰노이만 구조 때문이었다.

- 두뇌의 작동원리를 모방하다

오늘날의 인공지능과 유사한 인공신경망을 지닌 최초의 알고리즘은 연결주의의 중심인물인 프랭크 로젠블랫이 만든 퍼 셉트론Perceptron이다. 인공지능이 신경망 neural network으로 도약 을 준비하는 순간이었다. 로젠블랫은 뉴욕 주에 있는 코넬항공 연구소에서 인지시스템 부문 책임자로 활동하면서 1957년 퍼 셉트론이라는 인공신경망 시스템을 발표했다.

- 로젠블랫이 모방하고자 했던 것은 두뇌의 작동원리였다. 그는 생물학적 시스템이 실제로 어떻게 정보를 감지하는지, 정보 는 어떤 형태로 저장이 되는지, 저장된 정보는 우리 인식에 어 떤 영향을 주는지를 깊이 연구했다. 당시 신경망의 작동 방식 은 여전히 미지의 세계였다.

학계에서는 오직 두 가지 가설만이 존재했다. 첫 번째는 신 경망으로 들어오는 신호를 저장하는 별도의 기억장치가 존재 한다는 학설, 두 번째는 신경망에 있는 연결 자체가 신호를 저 장한다는 학설이었다. 퍼셉트론은 후자를 입증하기 위한 일종 의 도전적 실험이었다.

- 이해를 돕기 위해 우리가 컵을 인식하는 방법을 떠올려보자. 이 세상에는 수많은 컵이 존재한다. 하지만 인간은 컵의 모양 이 다르더라도 0.1초 내에 이것이 컵인지 아닌지를 식별할 수 있다. 망막에 상이 맺히면 그 정보는 우리 뇌에 있는 뉴런으로 이동한다. 신경세포인 뉴런이 모인 것이 대뇌피질이다.

뉴런은 정보의 강도에 따라 활성화되거나 비활성화된다. 뉴 런이 활성화되려면 일정한 자극, 즉 임계치 이상의 자극을 받 아야 한다. 활성화된 뉴런은 통로인 시냅스를 통해 결과값을 다른 뉴런으로 전달하고, 궁극적으로는 최상위에 있는 추상화 뉴런에 전달한다. 이 뉴런이 종합적으로 판별해 순식간에 컵인지 아닌지를 판단하는 것이다.

퍼셉트론은 인간의 뇌가 이러한 논리로 작동할 것이라는 가 설을 토대로 설계되었다. 단일 뉴런을 갖춘 인공신경망으로 시 각에 해당하는 인풋 노드(인풋 층)가 있고 여기에 들어온 정보 를 한 개의 뉴런에 해당하는 인풋 유닛에 전달한다. 인풋 유닛 은 패턴을 분류하고 그 결과값을 아웃풋 유닛에 전달한다. 중요한 것은 각 인풋 노드의 연결 강도다. 이는 뉴런의 받아들이 는 신호 자극의 세기를 모방한 것이다. 연산적으로는 가중치를 곱한 값을 합산해 결정하는데, 임계치보다 큰 경우 1의 결과, 그렇지 않을 경우 0의 결과를 도출하는 계단함수다. 따라서 결 과는 O와 X 두 개로 나타난다.

기호주의를 따랐다면 가중치를 직접 입력했을 것인데, 연결 주의를 표방한 퍼셉트론은 학습이라는 방법으로 이를 해결하 려 한 시도였다. 로젠블랫이 위대한 것은 가중치를 스스로 수 정하는 알고리즘을 만들었다는 데 있다.

- "속이고 잡아내라” GAN의 출현

2015년을 전후해 출현한 새로운 인공지능 모델들은 종전 모 델의 성능을 앞도하기 시작했다. 그동안 인공지능 모델은 신 경생물학의 영향을 받아 장기 기억을 저장하는 방법을 연구하 고 있었다. 신경심리학자인 도널드 헤브Donald Hebb는 자신의 책 《행동의 조직화 The Organization of Behavior》에서 우리 뇌가 무엇인가 를 기억하는 행위에 대해 전체가 아닌 극히 일부 뉴런에서 이 정보를 변환해 보관하고 있는 상태라고 주장했다. 신경세포인 뉴런들이 자극을 받아 동시에 활성화되면 그 사이 통로인 시 냅스의 연결이 강화되고 특정 시냅스에서 장기 강화LTP, long-term potentiation 현상이 나타난다는 메시지였다.

수십 년간 장기 기억은 인공지능 학계에서 큰 숙제였다. 자 연어 처리, 음악 작성, 컴퓨터 비전과 같은 시간차가 필요한 분 야에서는 반드시 인공지능이 장기적으로 기억할 수 있는 능력을 갖추고 있어야 했다.

- 예를 들어 한국어를 영어로 번역할 때, 첫 번째 입력한 단 어는 곧바로 이어지는 영어 단어 순서에 영향을 준다. 만약 인 공지능 기억이 매우 짧다면 번역은 불가능하다. 이 문제를 해 결하기 위해 순방향 신경망인 피드포워드 네트워크FFNN, Feed- Forward Neural Network를 업그레이드해 층 내에서 서로 되먹임할 수 있도록 한 순환신경망이 개발되었다.

오늘날 원본과 유사하지만 독창적인 그림이나 문장을 생성 하는 이른바 생성형 인공지능 역시 피드포워드 네트워크를 학 습시키는 과정에서 발견되었다. 몬트리올대학교의 이언 굿펠 로lan Goodfellow 팀은 인공지능이 적대적 상황에 놓이면 보다 강력한 샘플을 생성한다는 사실을 알아냈다. 이를 위해서는 이미지 · 동영상 · 텍스트 사운드를 분류하는 머신러닝의 한 유형인 합성곱 신경망이 필요하다. 한 인공지능은 꾸준히 그림을 그려대고, 또 다른 인공지능은 그 결과값을 입력값으로 받아들여 이 그림이 진짜인지 가짜인지를 판별하는 식이다. 마치 특수 경찰관이 위조지폐범이 계속해서 그려댄 위조지폐를 식별하면 서 서로 실력을 겨루고 발전하는 과정과 흡사하다. 이른바 생 성형 대립신경망GAN, Generative Adversarial Network의 등장이다.

특히 GAN은 별도로 학습을 시킬 필요가 없는 비지도 학습 을 토대로 한다. GAN을 활용하면 우주 천체 이미지에서 잡음을 제거할 수 있고 인간의 감정적인 언어 표현까지 생성할 수 있다. 이언 굿펠로는 졸업 후 오픈AI, 구글 리서치, 애플 등을 누비며 GAN을 전파했다.

GAN을 활용한 서비스들이 속속 등장했다. 미국의 대표 반 도체 기업인 엔비디아 NVIDIA에서 개발한 스타일GAN은 사실 적으로 사람 얼굴을 그리고 고해상도 이미지를 생성하며 패션 디자인에도 활용할 수 있다. 또 UC버클리에서 내놓은 사이클 GANCycleGAN은 다양한 이미지를 전환하는 데 성공했다. 말 사 진을 올리면 얼룩말로 전환되는 방식이다. 또 다른 UC버클리 팀이 만든 픽스투픽스pIx2Pix는 스케치 그림을 올리면 디지털 아트로 전환해준다. 오픈AI가 내놓은 달리 DALL-E 역시 GAN을 기반으로 이미지를 생성한다. 영어로 간단한 문장만 입력하면 원하는 그림을 얻어낼 수 있다.

- 챗GPT의 핵심은 트랜스포머다. 이를 통해 시퀀스 투 시퀀 스sequence to Sequence를 수행할 수 있다. 여기서 시퀀스란 무엇 인가를 나열한다는 뜻으로, 문장, 이미지 등 모든 것이 될 수 있 다. 다만 자연어 처리에서는 문장이 곧 시퀀스라 할 수 있다. 즉 한 문장을 넣으면 다른 문장이 되어 나타나는 것이다. 번역이나 추론, 전망도 이를 통해 가능하다. 주가예측을 한다면 '미국 연방준비제도가 금리를 올렸다'라는 시퀀스가 미국 나스닥이 하락했다'라는 시퀀스로 변경되는 것을 뜻한다.

트랜스포머에는 정교함을 극대화하고자 셀프어텐션self attention이라는 기능이 포함돼 있다. 모델에는 인코더Encoder와 디 코더Decoder가 존재하는데, 인코더가 입력 시퀀스를 압축해 디 코더로 보내면 디코더는 목표로 한 시퀀스를 생성한다. 인코더 에 들어온 시퀀스를 압축하는 과정을 인코딩이라고 부르고 나 가는 것을 디코딩이라고 한다. 오염된 물이 정수기 필터를 지 나가는 것과 흡사하다. 번역 인공지능을 예로 들면 '나는 너를 사랑한다'라는 한 문장의 시퀀스가 인코더에 들어오면, 디코더는 I love you’라는 번역 문장의 시퀀스를 생성한다.

구글의 트랜스포머 모델에서는 인코더에 들어온 시퀀스가 셀프어텐션 레이어를 지나도록 하고 있다. 오픈AI의 트랜스포 머 모델에서는 디코더에 마스크드 셀프어텐션 레이어가 있다. 셀프어텐션은 말 그대로 '스스로 집중한다'는 뜻이다.

인간의 뇌를 생각해보자. 한 사람이 편의점 문을 열고 들어 와 "아...... 그, 저 말인데요. 저기 있는 우유 얼마인가요?" 하고 우물쭈물 묻는다면, 점원은 "아...... 그, 저 말인데요"보다는 "저기 우유 얼마인가요?"라는 문장 속 주요 단어를 재빠르게 파악할 수 있다. 우리 뇌는 이처럼 수많은 단어 속에서 핵심만 추리 는 능력이 있는 것이다.

마찬가지로 셀프어텐션 레이어는 가장 중요하고 관련 있는 정보를 집어낸다. 한 시퀀스가 입력되더라도 '하지만', '그러나', '결론적으로'와 같은 주요 토큰에 집중한다. 또 디코더로 나가 는 시퀀스에 있는 마스크드 셀프어텐션 레이어는 정교한 시퀀스를 형성하도록 돕는다.

- 지금까지 인공신경망 모델은 문장이 길어질수록 문맥을 해석하는 것을 힘들어했다. 모든 단어를 일일이 훑어서 분석해야 했기 때문이다. 하지만 트랜스포머 모델은 셀프어텐션 레이어 를 통해 집중할 수 있다. 아무리 문장에 단어가 많더라도 필요 한 정보만 빠르게 이해하고 불필요한 단어를 내뱉지도 않는다. 챗GPT에 오타가 수두룩한 문장을 대충 입력해도, 사용자의 뜻 을 헤아려 군더더기 없이 답변하는 것은 바로 트랜스포머의 힘 이다.

- "인공 일반 지능이 개발되면, 자본주의가 무너질 수 있다. 인공지능이 스스로 수익을 창출하면 어떻게 배분할 것인가. 또 이런 인공지능은 누가 통제할 수 있을 것인가." (오픈AI 공동창업자 샘 올트먼)

- 샘 올트먼은 왜 챗GPT를 공개했는가

샘 올트먼은 오픈AI 설립 이유를 사회 운동으로 설명했다. 그는 2023년 <포브스>와의 인터뷰에서 챗GPT를 무료로 외부 에 공개한 이유를 '오버톤 윈도overton Window' 효과를 위해서라고 언급하기도 했다.3

오버톤 윈도는 극단적 선택지 가운데 대중이 받아들일 수 있 는 정책과 사고의 범위를 말하는데, 외부 충격에 따라 수용 여 부가 달라진다. 1998년 외환위기를 계기로 국제통화기금IMF이 대규모 정리해고를 권고하자, 근로자들은 저항 없이 수용했다. 일반인들이 인공지능에 대한 경외심과 공포감을 가지라는 메 시지를 던지고자 기술을 공개했다는 것이다.

올트먼은 특히 인공지능이 고도로 발달할 경우 자본주의가 무너질 수 있다고 경고했다. 인공지능이 인간을 대신해 스스로 수익을 창출하는 세상이 온다면, 시장 경제의 근간인 사유재산 에 대한 권리를 더 이상 주장하기 힘들 것이라는 뜻이다. 그는 "자본주의를 사랑한다"면서도 "하지만 자본주의는 나쁜 시스템 중에서 가장 좋은 시스템이기 때문에, 현존하는 더 나은 방안 을 찾았으면 한다"라고 말을 이었다.

- 오픈AI는 기존의 기업과는 다른 방식으로 만들어졌다. 올트 먼은 구체적으로 "인공 일반 지능은 (스스로 일해) 수익을 발생 시킬 텐데 이를 어떻게 배분해야 할지가 관건일 것"이라며 "이 런 인공지능을 누가 통제할 수 있으며, 이를 소유한 회사는 어 떤 지배구조(거버넌스)로 구성이 되어야 하는지 등 새로운 생각 이 필요하다"라고 말했다. 막대한 성능을 지닌 인공지능이 고장날 경우 특별한 조치가 필요할 수 있고, 이 때문에 특정 회사 가 이런 인공지능을 소유해서는 안된다는 말도 잊지 않았다.

- 2018년 머스크는 오픈AI가 구글에 비해 뒤처져 있다고 주장 하면서 직접 CEO로 나서겠다고 밝혔다. 하지만 다른 공동창 업자들이 반대에 나섰고, 이후 머스크는 오픈AI를 떠나게 되었 다. 약속한 투자 계획 역시 중단했다. 추가 자금이 필요했던 오 AI는 오픈AI 유한투자 openAI LP라는 영리 자회사를 설립했다. 머스크가 빠진 자리는 마이크로소프트가 대신했다. 마이 크로소프트는 2019년 오픈AI에 초기 투자를 단행했고, 이후 2022년까지 총 100억 달러에 달하는 자금을 투자하며 그 대가 로 파트너십을 요구했다. 챗GPT의 업데이트 버전은 마이크로 소프트의 챗봇인 '빙'에 탑재되었고, 마이크로소프트는 구글이 장악한 검색 시장을 점점 확대 중이다.

- 챗GPT는 코드 생성 기능을 장착한 업데이트 버전인 GPT- 3.5를 토대로 하는데, 2022년 1월 발표한 언어처리 모델인 인 스트럭트GPT의 장점을 결합한 융·복합 버전이다. 특히 수요 자의 트래픽이 몰리는 것에 따라 다른 버전을 적용하는 동적 모델인 것으로 알려졌다. 실리콘밸리에서는 GPT-3 스몰 또 는 GPT-3 XL이 동적으로 구동하는 것으로 추정하고 있다. 사 용자 수요가 몰리면 파라미터가 적은 버전이 등장하고, 수요가 없으면 큰 파라미터가 있는 버전이 구동되는 방식이다.

파라미터 수가 서버 안정성과 직접적인 관련은 적지만, 파라 미터 수가 늘면 실행에 상당한 컴퓨팅 리소스가 투입돼야 하는 문제점이 발생한다. 때문에 사람이 뜸한 한적한 시간에 사용하 면 매우 빠른 속도로 정확한 답변을 내놓는 데 반해, 사람이 몰 리는 시간대에 활용하면 성능이 저조한 것 같은 기분이 드는 이유 역시 챗GPT가 동적 버전이기 때문인 것으로 보인다.

- 오픈AI는 현지 시각 2023년 3월 14일, 챗GPT의 골격인 초거대 인공지능 GPT를 GPT-4로 업데이트했다고 밝혔다. 이날 샘 올트먼 오픈AI CEO는 트위터를 통해 "GPT-4는 가장 뛰어 나고 정리가 잘 된 모델"이라고 강조했다.

GPT-4는 현재 GPT의 근간이 되는 GPT-3.5의 업데이 트 버전으로 미국 모의 변호사시험에서 상위 10퍼센트, 미국 대학 입학 자격시험인 SAT 읽기와 수학에서 각각 상위 7퍼센 트와 11퍼센트의 성적을 기록했다.

추론 능력도 대폭 향상되었으며, 인공지능이 거짓말을 하는 이른바 '환각hallucination 현상' 역시 감소시켰다. 오픈AI는 “GPT-4가 허용되지 않은 콘텐츠 요청에 응답할 가능성이 82퍼 센트 줄었다"면서 "사실을 바탕으로 대답하는 비율도 GPT-3.5 보다 40퍼센트 정도 높아졌다”라고 설명했다.

가장 주목받는 것은 이미지를 올리면 텍스트로 인식하는 기 능이다. 이미지 속의 그림이나 글자를 인식해 대화를 주고받을 수 있다. 예를 들어 복잡한 의약품을 스마트폰 카메라로 촬영 해 업로드하고 해당 제품의 성분과 장단점을 물어볼 수 있다. 더 놀라운 점은 식재료 분석이다. 식재료 사진을 아무렇게나 촬영해 올리면, 챗GPT가 해당 식재료로 만들 수 있는 요리와 그 요리 조리법을 작성한다.

텍스트 분석 기능도 대폭 업데이트돼 GPT-4는 2만 5000단어 이상을 한 번에 분석한다. 오픈AI는 "URL을 입력하면 보다 긴 형식의 콘텐츠를 생성할 뿐 아니라, 보다 정교하게 분석할 수 있다"라고 설명했다. 하지만 GPT-4가 얼마나 많은 파라미 터를 가졌는지에 대해서는 함구했다.

파라미터란 인간의 뇌에 있는 시냅스와 같은 요소로 파라 미터가 많다는 것은 그만큼 연산 능력이 높아 복잡한 문제를 더 정교하게 처리할 수 있다는 것을 의미한다. GPT-3.5는 1750억 개의 파라미터를 갖고 있다. 오픈AI는 챗GPT 무료 버 전은 GPT-3.5, 유료 버전인 '플러스'는 GPT-4에 연동했다고 밝혔다.

이러한 발전은 샘 올트먼 오픈AI CEO가 강조한 인간을 대 신하고 스스로 학습하는 인공 일반 지능에 다소나마 근접하는 양상이다. 인공 일반 지능을 장착한 챗GPT는 파라미터 수가 100조개에 달해, 인간 시냅스 100조 개에 버금가는 능력을 지 닐 것이라는 기대를 받고 있다. 오픈AI의 공동창업자 샘 올트 먼은 2022년 9월 한 팟캐스트에 출연해 가까운 미래에는 멀티 모달 Multi Modal 이 장착된 인공지능이 출현할 것으로 전망했다.

- 챗GPT는 인간의 언어인 자연어를 이해하고 분석해 코드를 생성한다. 챗GPT의 근간인 초거대 인공지능 GPT-3.5에 코드 를 생성해 주는 'code-davinci-002'라는 기능이 추가됐기 때문 이다. GPT-3.5는 159 기가바이트 분량의 코드를 학습한 코덱 스Codex를 연동하고 있어 다양한 코드 생성이 가능하다. 일정 부분 코딩에 대한 이해와 논리, 그리고 자신이 무엇을 원하는 지 정확히 아는 사용자라면 원하는 코드를 생성할 수 있다. 책 GPT가 소프트웨어 업계의 게임체인저로 불리는 이유다. 이런 챗GPT가 파고들 영역은 전방위적이다.

- 지금껏 프로그래머들은 프론트엔드, 백엔드, 모바일 개발, 머 신러닝, 게임 개발 등 한 분야에 특화되어 있었다. 전체를 총괄 하는 풀스택 개발자가 없는 것은 아니지만 극히 드물다. 하지 만 챗GPT는 이를 모두 소화할 수 있다. 챗GPT로 다룰 수 있 는 프로그램 언어는 약 12종(HTML, CSS, 자바스크립트 JavaScript, 파이썬 Python, 루비 Ruby, Node.js, 텐서플로우 TensorFlow, 파이토치PyTorch, 판다스Pandas, 매트플롯립 Matplotlib, 유니티 Unity, 언리얼 엔진Unreal Engine)으로, 웬만한 프로그래머보다 더 많은 일을 할 수 있다.

- 테슬라의 인공지능 담당자에서 오픈AI로 자리를 옮긴 안드레이 카르파티 Andrej Karpathy 는 2023년 1월 트위터를 통해 "오늘 날 가장 인기 있는 새로운 프로그램은 영어"라고 강조했다. 그 만큼 프롬프트 엔지니어의 중요성이 날로 커지고 있다는 메시 지다.

일부 프롬프트 엔지니어는 자신이 개발한 프롬프트를 프롬 프트베이스promptBase 같은 사이트에서 판매하기도 한다. 프롬 프트베이스에 따르면, 2021년 이후 현재까지 2만 5000명이 프 롬프트를 판매했다. 예를 들어 이미지 생성 인공지능인 미드저 니Midjourney를 통해 정확히 원하는 그림을 생성해내는 프롬프트 는 단어 50개로 구성이 돼 있는데 약 1.99달러에 판매된다. 그 만큼 수요가 크다는 방증이다. 또한 프롬프트 히어로PromptHero, 프롬피티스트promptist와 같은 프롬프트 안내 및 교환 사이트도 등장하고 있다.

- 물론 이 새로운 직업에 대한 부정적인 의견도 존재한다. 워 싱턴대학교의 셰인 스타이너트트렐켈드Shane Steinert-Threlkeld 교수 는 프롬프트 엔지니어링에 대해 "프롬프트 엔지니어링은 과학 이 아니다”라고 주장하면서 "곰을 여러 방법으로 찔러 보고 어 떻게 그들이 포효하는지 분석하는 것과 무엇이 다른가?" 지적 하기도 했다. 그러나 대다수 전문가는 오늘날 모든 것이 자연 어로 가능해지면서, 프롬프트를 제대로 활용할 수 있는 사람에 대한 수요가 갈수록 늘어날 것으로 보고 있다.

- 인공지능을 활용한 투자가 늘어나면서 인공지능을 활용해 이를 감시하는 '레그테크RegTech'마저 등장하고 있다. 레그 테크는 규제Regulation와 기술 Technology의 합성어로 금융 서비스 의 문제를 해결하기 위한 혁신적 기술을 뜻한다. 일본 금융청은 2017년 이 같은 중기 활동 방침을 발표했다. 수많은 사람 이 인공지능을 활용해 매매하면서 주가가 요동치고, 레이어링 Layering 방식으로 일반인들이 피해를 보기 때문이다.

레이어링은 알고리즘이 매도 주문을 순식간에 쏟아내 주가 를 하락시킨 뒤 저점에서 다시 주식을 매집하는 행위를 가리 킨다. 사람이 클릭하기도 전에 알고리즘이 움직여 기존의 규제방식으로는 이러한 패턴을 찾아내는 것이 불가능하다. 때문에 앞으로는 금융감독기관이 인공지능을 활용해 문제점을 포착하는 날이 머지않아 도래할 것으로 보인다.

- 오늘날 인공지능은 금융 산업 전반을 혁신하고 있는 강한 무기다. 개인 금융 서비스, 신용 평가 및 대출, 시장 동향 분석 및 예측, 로보틱 프로세스 자동화RPA, 금융 규제 및 이상거래 탐 지 등에 사용이 가능하다. 딜로이트컨설팅의 김석태 이사는 "인공지능 활용이 확대되면서 금융업의 경쟁 구도가 재편될 것 으로 보인다"면서 "앞으로 직원과 인공지능의 협업 역량이 새로운 경쟁력이 될 것 같다"고 설명했다.

- 전 세계에서 가장 많은 전기차를 팔고 있는 테슬라는 GPT를 기반으로 자율주행 기능인 오토파일럿의 성능 업그레이드 를 시도하고 있다. 24 테슬라 차량에는 수많은 반도체가 탑재되 는데 그 핵심은 트립TRIP 칩이다. 트립 칩은 자율주행에 필요한 복잡한 계산을 빠르고 효율적으로 처리한다. 트립 칩을 사용하 면 서버에 있는 GPU와 연동이 필요 없다. GPU와 소통하는 시 간을 줄여 인공지능 처리 속도를 높일 수 있기 때문이다. 테슬 라 오토파일럿은 트립 칩을 토대로 통신하면서 오류를 실시간 으로 감지하고 차량 이상을 파악한다. 인공지능이 다양한 운전 변수를 학습했기 때문에 가능하다.

문제는 효율이다. 이러한 학습 과정에는 소프트웨어 조정 방향을 사람이 알려주는 이른바 '휴리스틱neuristic 프로세스'가 사 용된다. 하지만 인간의 개입은 효과적이지 않아 GPT는 그 대 안으로 꼽힌다. GPT는 자연어를 생성하지만, 이미지나 동영상 픽셀 위치에 대한 공간 정보를 제공한다. 이를 자율주행에 접 목하면 휴리스틱을 크게 개선할 수 있다. 테크 유튜브 채널인 '닥터노우잇올Dr.Know It All'을 운영하는 존 깁스John Gibbs 조지아대 학교 교수는 머스크와 대화 직후 "테슬라가 트립 칩에 GPT를 사용하려고 한 것은 매우 인상적"이라면서 "이것이 만약 성공 적으로 구현이 된다면 자율주행 문제가 더 빨리 해결될 수 있 다"라고 설명했다.

- 생성형 인공지능이 자유자재로 문장을 생성하면서 산업의 전체 판도가 흔들리고 있다. 오픈AI 출신으로 또 다른 생성형 인공지능 스타트업인 앤스로픽(구글이 2023년 2월 4억 달러를 투 자했다.)을 공동창업한 크리스토퍼 올라 Christopher Olah는 트위터 에서 이 같은 힘을 "소프트웨어 3.0'이라고 불렀다. 챗GPT의 근간이 되는 초거대 인공지능 GPT에 메타 학습Meta Learning을 접목하는 방법을 연구했고, 이를 기반으로 프롬프트 프로그래 밍을 했다는 설명이다.

'메타 학습'이란 인공지능이 경험을 통해 스스로 학습 프로 세스를 개선하는 학습법이다. GPT-3.5는 소량의 데이터로 기 계가 학습하는 퓨샷러닝으로 다양한 상황에서 대응이 가능했 다. 또 프롬프트 프로그래밍을 통해 사용자의 의도를 정확히 파악할 수 있도록 했다.

- CRM의 양대 산맥은 마이크로소프트와 세일즈포스Salesforce 다. 특히 세일즈포스는 기업용 소프트웨어 업계의 애플로 불린 다. 수많은 외부 소프트웨어를 구독 플랫폼처럼 운영하기 때 문이다. 세일즈포스는 이미 2017년에 아인슈타인 Einstein이라는 CRM을 선보이면서 인공지능을 전면에 내세웠다.

하지만 챗GPT 개발사인 오픈AI에 투자하고 파트너십을 맺 은 마이크로소프트가 움직였다. 마이크로소프트는 2023년 3월 '다이내믹스 365 코파일럿'이라는 시범 서비스를 선보였는데, 인공지능이 고객 문의에 대해 응대하고, 이메일 답변을 작성하 며, 마케터가 목표로 삼을 고객을 분류해내는 기능을 담았다. 앞서 사티아 나델라Satya Nadella 마이크로소프트 CEO는 자사의 모든 제품 라인업을 오픈AI의 인공지능 도구를 활용해 재정비 할 것이라고 밝힌 바 있는데 이를 곧바로 시연한 것이다.

업계 1위인 세일즈포스 역시 오픈AI 챗GPT를 접목한 아 인슈타인GPTEinstein GPT라는 서비스를 선보이며 맞대응에 나 섰다.22 아인슈타인은 프롬프트에 명령어를 입력하면 문장 요 약, 개인 맞춤형 이메일 발송, 마케팅용 코드 등을 생성한다. 또 기업이 광고 캠페인에 사용할 수 있도록 이미지도 만들어낼 수 있다.

차별점은 공개된 정보나 세일즈포스에 있는 각종 데이터를 불러낼 수 있으며, 각 기업이 자체 데이터를 이용해 인공지능 을 훈련시킬 수 있다는 점이다. 기업이 자체 인공지능을 구축 할 수 있는 것이다. 아울러 생성형 인공지능이 거짓 정보를 생 성하는 환각 현상을 방지하고자 인공지능이 생성한 답변을 이 용자가 사용하기 전에 확인하는 절차를 도입했다.

- 언어를 이미지로 생성하는 '스테이블 디퓨전'

스테이블 디퓨전은 인간의 문장을 토대로 이미지를 만들어 내는 딥러닝 인공지능 모델로, 자연어인 텍스트를 입력하면 이 미지를 생성한다. 자연어처리 분야에 GPT를 중심으로 한 트랜스포머 모델 기반 인공지능이 있다면, 이미지 분야에선 스 테이블 디퓨전 모델이 중심이다. 그동안 수많은 이미지 생성 인공지능이 등장했지만, '와우 모먼트'를 달성하는 데에는 실패 했다. 하지만 스테이블 디퓨전은 2022년 급부상해 많은 이의 감탄을 불러왔다.

인공지능의 프로세스는 크게 데이터 트레이닝 딥러닝→ 잠재공간latent space 배치→ 생성(디퓨전diffusion)→ 결과인 아웃풋 으로 이뤄진다. 이미지 생성 딥러닝은 이미지와 그 이미지에 대한 설명인 캡션caption 짝을 대조해보는 방식으로 학습이 이뤄 진다. 컴퓨터는 이미지에 대한 세세한 화소점인 픽셀을 숫자로 인식하고 그 패턴 값을 분석하고 이를 설명 문장과 대조하며 학습한다.

이렇게 학습된 생성형 인공지능은 문장이 입력되면 가상공간에 그림을 배치하는데 이를 잠재공간 배치라고 한다. 예를 들어 엑스축이 빨간색, 와이축이 원형이라고 한다면, 맨 상단 우측에 빨간 공이, 맨 하단 좌측에 노란 바나나가 배치될 것이 다. 문제는 여기서 발생한다. 복잡한 문장을 입력하면 변수가 급증하기 때문에 인공지능이 잠재공간에 이미지를 집어넣는 데 착오를 일으킬 수 있다. 가끔 얼굴이 두 개 달린 인물 이미 지가 그려지는 이유다.

하지만 스테이블 디퓨전은 인간이 인식할 수 있는 공간을 넘 어 매우 방대한 공간을 처리할 수 있는 능력을 갖고 있다. 그 비결은 역방향 학습이다. 디퓨전이란 영어로 '퍼짐'이라는 뜻으로 "안정적 확산 모델"이라고도 부른다. 투명한 물에 빨간 잉크 한 방울을 떨어뜨리는 모습을 상상하면 이해가 쉽다. 잉크 방 울은 서서히 퍼져 특정 시간에 도달하면 물 전체를 빨갛게 물 들인다. 평형 상태에 도달한 것이다.

실제 세계에선 한번 평형이 이뤄지면 원점으로 돌아올 수 없다. 하지만 스테이블 디퓨전은 안정적으로 확산된 상태를 다 시 원점으로 돌리는 능력이 있다. 이는 매우 잘 그린 초상화를 백지가 될 때까지 손으로 문질러 없앤 뒤, 지운 그림을 생각하 면서 다시 그리는 것과 같은 이치다. 인공지능은 이 과정을 무 한으로 반복한다. 학습할 때에는 그림을 지워 없애는 방식을 쓰지만, 실제 작업을 수행할 때에는 역방향으로 움직인다.

스테이블 디퓨전은 독일 뮌헨대학교 연구진이 스타트업 스 태빌리티AIstability Al의 지원을 받아 2022년 8월에 개발한 인공 지능이다. 이 모델은 인공지능 학습에만 60만 달러에 달하는 거액이 들어갔지만 스태빌리티AI와 뮌헨대학교는 이를 누구나 사용할 수 있도록 오픈소스로 공개했다.

생성형 인공지능 서비스로는 이미 미드저니, 오픈AI 달리, 드림 바이 웜보Dream by WOMBO 등이 이미 존재하고 있었지만, 스 테이블 디퓨전이 오픈소스로 공개되면서 수많은 기업이 이 모델을 주로 이용하고 있다.

- 넷스케이프를 창업한 마크 앤드리슨이 이끄는 실리콘밸리 벤처캐피털인 앤드리슨호로위츠Andreessen Horowitz는 생성형 인공 지능의 산업 영역을 크게 세 가지로 분류했다. 인공지능 칩과 그 칩을 활용해 컴퓨팅 파워를 제공하는 인프라 산업, 이 컴퓨 팅 파워를 활용해 생성형 인공지능을 직접 개발하는 파운데이 션 모델, 다시 이 파운데이션 모델을 활용해 B2B(기업 간 기업) 나 B2C(기업 간 소비자)용으로 앱과 웹을 제공하는 서비스다. 여기에서 어떤 수익 구조를 갖느냐에 따라 다시 세분화된다.

맷 본스틴Matt Bornstein 파트너는 “현재까지는 인프라 공급 회 사가 시장의 승자일 가능성이 크다"면서 "앱을 제공하는 회사 는 매출이 급속도로 늘고 있지만 아직 수익이 충분하지 않고, 인공지능 모델을 제공하는 업체는 수익 구조를 만들지 못한 상 태"라고 진단했다. 산업이 꿈틀대는 초기 단계이기 때문에 미 래를 섣불리 예단하기 힘들다는 설명이다.

- 오픈소스 생태계는 독특한 비즈니스 모델을 만들어냈다. 바로 모델 허브 비즈니스다. 스테이블 디퓨전이 오픈소스로 제공 되더라도 일반 기업이 이를 활용해 서비스를 개발하는 것은 쉬 운 일이 아니다. 하지만 허깅페이스와 같은 모델 허브를 활용 하면 비교적 쉽게 구축할 수 있다.

허깅페이스는 다양한 모델과 학습 스크립트를 모아 놓은 라 이브러리 서비스를 제공하고 있다. 레고를 생각하면 이해가 쉽 다. 오픈소스 모델이 개별 레고 블록이라고 한다면, 허깅페이스 는 이를 색상과 모양별로 모아둔 상자라고 할 수 있다.

- 빙 챗봇은 챗GPT에서 한 단계 업데이트됐다. 챗GPT가 2021년 이후 사실에 대해선 알려주지 않지만, 빙 챗봇은 검색 사이트를 훑어 출처까지 인용해 요약·정리해준다. 예를 들어 2023년 가장 인기 있는 스마트폰이 무엇인지 묻는다면, 삼성전 자와 아이폰의 최신 정보를 나열한다. 여기에 GPT의 기본 기능마저 담고 있다.

더 나아가 마이크로소프트는 빙 챗봇에 오픈AI의 이미지 생 성 인공지능인 달리를 탑재했다. '빙 이미지 크리에이터'라고 명명된 이 기능은 이미지를 생성해달라고 요청하면, 오픈AI의 달리가 곧바로 그림을 그려주는 방식이다. 또 인공지능이 생성한 인포그래픽과 차트 등을 사용할 수 있도록 비주얼 스토리와 지식 카드와 같은 새로운 기능마저 추가했다.

이처럼 마이크로소프트가 GPT를 탑재한 이유는 구글을 단 숨에 추격하기 위해서다. 다만 복병도 있다. 빙 챗봇은 전 세계 100만 명을 상대로 우선 공개됐다. 모든 사용자에게 공개할 경 우서버 비용을 감당할 수 없어서다. 시장이 확대되는 모습을 보면서 서서히 대상을 늘리겠다는 전략이지만, 추격에 상당한 시일이 소요될 것이라는 점을 시인한 것이다.

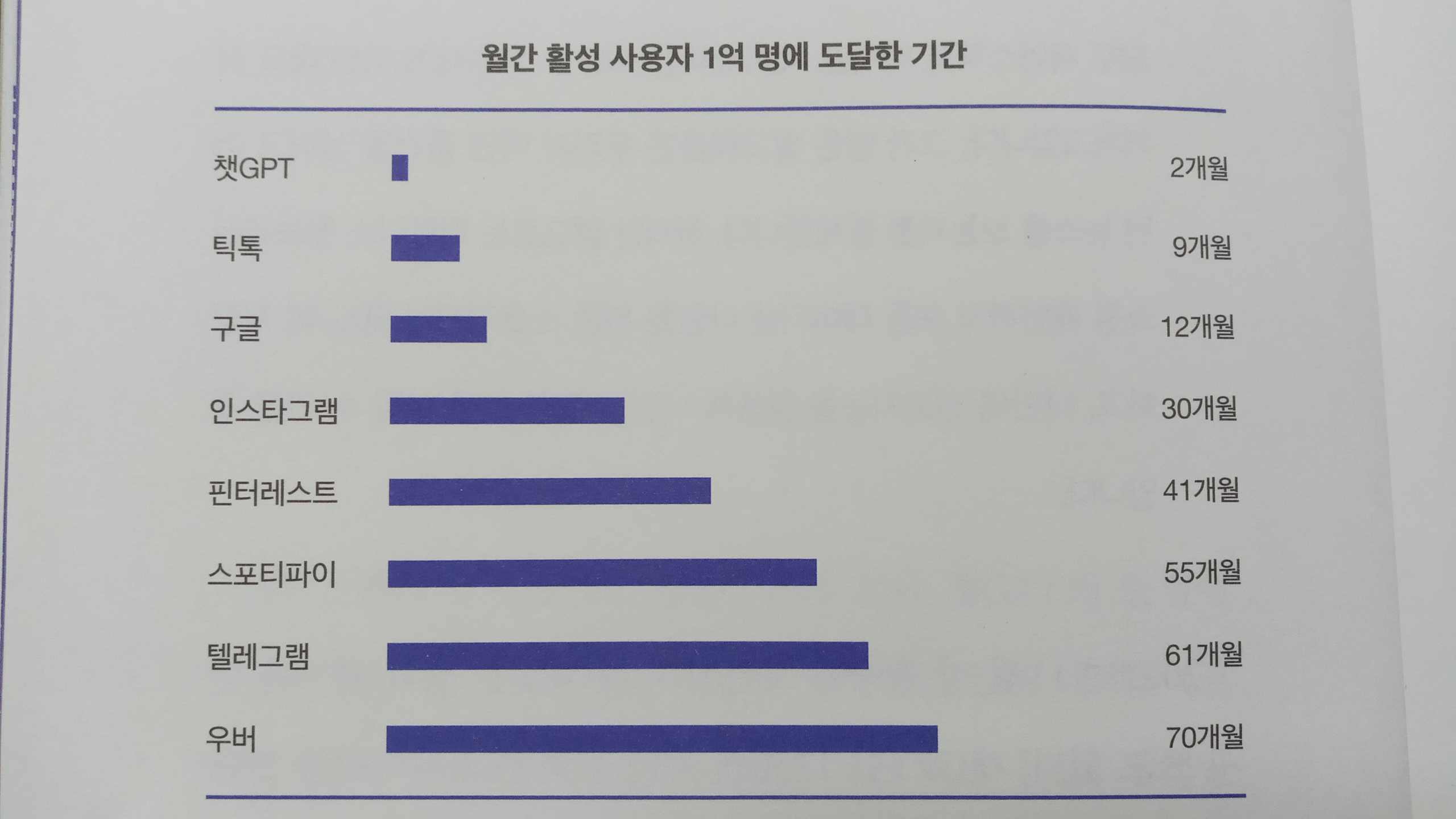

빙 챗봇 사용 대기리스트에 이름을 올리기 위해서는 마이크 로소프트의 지시를 따라야 한다. 윈도우를 업데이트해 검색엔 진 기본값을 구글에서 빙으로 바꿔야 하며, 웹브라우저인 엣지를 업데이트해야 한다. 시장에서는 마이크로소프트의 이러한 전략이 당장 통했다는 평가가 나왔다. 빙 챗봇을 도입한 이후 빙의 일간 활성 사용자DAU는 1억 명을 돌파했다. 2009년 빙이 출시한 이래 처음이었다. 특히 빙 챗봇 이용자의 3분의 1은 빙 을 처음 사용하는 신규 사용자였다.

마이크로소프트가 막대한 자본을 투자해 빙 챗봇을 개발한 이유는 디지털 광고 때문이다. 검색 광고 시장에서 점유율이 1퍼센트 상승할 때마다 디지털 광고 수익은 약 20억 달러가 증가하는 것으로 알려졌다. 마이크로소프트는 이에 그치지 않고 웹브라우저 시장 저변을 넓혀나가고 있다.

검색엔진이 웹사이트라면 웹브라우저는 이를 구동하는 프로 그램이다. 웹브라우저 시장을 장악하면, 이용자의 인터넷 이용 데이터를 손쉽게 얻을 수 있을 뿐 아니라 자사의 검색엔진으로 유도하기가 수월하다. 이 시장은 한때 마이크로소프트의 인터 넷 익스플로러가 대부분을 차지했지만, 현재는 구글의 크롬이 60퍼센트를 차지하고 있다. 엣지의 점유율은 고작 10퍼센트 남 짓이다.

- 메타의 초거대 인공지능 '라마'는 파라미터 수가 최대 650억개다. 이는 GPT-3.5 1750억 개, 구글 람다 1370억 개에 비해 적은 숫자지만, 발 빠른 대응이 아닐 수 없다. 현재 라마 개발은 메타의 부사장 겸 수석 AI 과학자인 얀 르쿤 Yann LeCun이 이끌고 있다.

메타 역시 구글처럼 모델을 섣불리 공개하지는 않고 있다. 2022년 11월 챗GPT에 맞불을 놓고자 인공지능 챗봇 갤럭 티카 Galactica를 공개한 뒤 곤욕을 치른 학습 효과가 있기 때문 이다. 10 당시 갤럭티카는 가짜 정보 생성은 물론 혐오적 표현 을 사용해 논란을 불러일으켰다. 현재는 연구자들을 대상으로만 라마의 사용 신청을 받고 있다. 연구용으로 고안된 만큼 일 반 사용자에겐 공개하지 않는 것이다. 메타의 라마가 오픈AI의 GPT나 구글의 람다에 비해 우수한 분야는 상식 추론으로 꼽 힌다. 인공지능은 학습을 하지 않은 데이터를 물어볼 경우 논 리에 맞지 않는 가짜 정보를 생성하기 쉬운데, 라마는 상식 추 론 능력이 이들보다 뛰어나다는 평가다.

투자자들이 주목하는 것은 메타가 생성형 인공지능 산업에 서 오픈소스 비즈니스 모델을 채택했다는 점이다. 후발 주자로 서 생태계를 더욱 빠르게 장악하고자 무료 공개 전략을 수립한 것이다. 저커버그는 "언어 모델의 발전에도 이를 학습시키고 실행하는 데 필요한 자원의 한계로 완전한 연구는 여전히 제한 적"이라며 "이런 제한된 접근은 인공지능 모델의 편향성, 유해 성, 잘못된 정보 생성 등의 문제를 완화하려는 연구자들의 노 력을 방해한다"고 설명했다. 더 많은 이가 메타의 인공지능을 활용할 수 있도록 하겠다는 메시지다.

메타가 라마의 개발을 완료하면 소셜미디어 역시 크게 탈바 꿈할 것으로 보인다. 저커버그는 앞서 "생성형 인공지능에 초 점을 맞춘 최상위 제품 그룹을 만들고 있다"고 강조한 바 있다. 생성형 인공지능을 연구하는 팀을 단일 팀으로 구성하고 모든 제품을 인공지능 기반으로 업데이트하겠다는 구상이다. 페이스북, 인스타그램, 왓츠앱 WhatsApp 등에 라마 기반 챗봇이 탑재 될 가능성을 시사하는 대목이다.

- 티스타에 따르면, CRM 시장에서 세일즈포스 점유율은 23.8퍼센트로 SAP 5.4퍼센트, 마이크로소프트 5.3퍼센트, 오라클 5.1 퍼센트, 어도비 3.8퍼센트보다 압도적으로 높다. 이런 가운데 마이크로소프트가 CRM 서비스에 챗GPT를 접목하면서 비상 이 걸렸고, 세일즈포스는 정공법을 택했다. 오픈AI의 GPT를 연동해 그 이상의 서비스를 구현하는 전략이다. 새로운 인공지 능 서비스 명칭은 '아인슈타인GPT다.

아인슈타인GPT는 프롬프트에 문장을 입력하면 요약, 개인 이메일, 마케팅 코드 등을 생성한다. 또 기업이 캠페인에 사용 할 수 있도록 이미지도 만들어낼 수 있다. 특히 공공 정보나 세일즈포스 등에서 각종 데이터를 불러낼 수 있으며, 각 기업이 자체 데이터를 이용해 자사만의 아인슈타인GPT를 훈련할 수 있도록 했다. 앞서 인수한 메신저형 협업 툴 슬랙slack을 위한 챗GPT 앱도 출시한다. 챗봇은 슬랙에서 대화를 요약하고 답장 을 쓰고 사용자가 주제를 조사하도록 지원한다.

마이크로소프트와의 차별화도 잊지 않았다. 빙 챗봇이 거짓 정보를 생성하는 이른바 '환각 현상'을 만드는 것을 보고, 아인 슈타인GPT는 인공지능이 생성한 답변을 이용자가 사용하기 전에 확인하는 절차를 추가하기로 했다. 클라라 쉬Clara Shin 세일즈포스 총괄매니저는 “이번 발표는 기업의 수요에 부응한 것"이라며 "기업들이 고객과 소통 방식을 재정립하는 데 생성형 AI가 도움을 줄 것"이라고 설명했다.

- 카툰피플 Cartoon People의 창업자인 사이드 라샤드syed Rashad는 "사진이 처음 발명되었을 때 신문, 광고, 디자인 회사 등에서 일 했던 수많은 초상화 화가가 직장을 잃었다"면서 "사진이 예술 인지 여부에 대한 논쟁은 나중에 다루어야 할 문제이고, 당면 한 과제는 인간이 기술을 억제할 수 없다는 데 있다"라고 말했 다. 사진기가 등장하면서 사진사가 필요했듯, 인공지능을 활용 해 보다 더 창의적으로 그림을 자유자재로 그릴 수 있는 사람 만이 생존할 수 있다는 메시지다.

'IT' 카테고리의 다른 글

| AI예감 (3) | 2024.07.28 |

|---|---|

| 크립토사피엔스와 변화하는 세상의 질서 (3) | 2024.01.31 |

| 챗 GPT 거대한 전환 (1) | 2023.12.24 |

| 오늘날 우리는 컴퓨터라 부른다 (2) | 2023.12.07 |

| 박태웅의 AI강의 (1) | 2023.12.05 |